AI晶片廠盼FP8格式標準化

科技產業資訊室 (iKnow) - Gloria 發表於 2022年7月13日

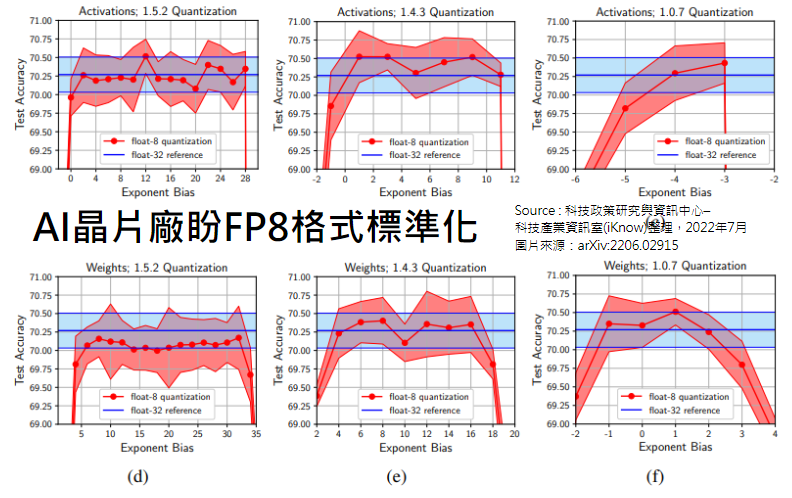

圖、AI晶片廠盼FP8格式標準化

2022年3月,輝達(NVIDIA)推出了第一款基於全新Hopper架構的GPU—GH100,其目標市場是高效能運算(HPC)和AI工作負載。對AI工作負載更重要的是,GH100支持8位元浮點處理格式(FP8)。兩個月後,競爭對手英特爾也推出了採用FP8格式的第二代AI訓練晶片Gaudi2。

FP8格式之所以重要的原因有很多,其中最重要的是,AI推理之間存在一種分裂,在整數格式(通常為INT8,但有時為INT4)以低精確度完成,在AI訓練以FP16、FP32或FP64精確度完成,在HPC以FP32或FP64精確度完成。輝達和英特爾都認為FP8不僅可以用於推理,在某些情況下還可以用於AI訓練,從而從根本上提高加速器的有效吞吐量。

這真的很重要,因為在浮點和整數格式之間來回切換是一件令人頭疼的事情,如果能讓所有內容都停留在浮點中變得容易很多。此外,在未來的某個時候,如果推理轉移到8位FP8甚至可能是4位FP4格式,這意味著致力於整數處理器的有價值晶片資產可以被釋放並用於其他用途。

2022年6月,Graphcore研究發展低精確度浮點格式卓越性能,以及其能降低AI訓練中功耗的長期好處。低精確度數字格式可能是大型機器學習模型的關鍵組成部分,其不僅提供了最先進的準確性,同時減少了對環境的影響。特別是,通過使用FP8算術之能量效率比起FP16提高多達4倍,比FP32提高多達16倍。

如今Graphcore正在鼓吹IEEE針對AI設計採用FP8格式,並成為所有廠商都可以使用的標準。

超微和高通也支持Graphcore的計劃,高通認為FP8格式,不僅可為推理和運算提供了顯著的性能和效率提升,還可以幫助降低雲端和邊緣之訓練和推理成本。超微預計將在即將推出的Instinct MI300A APU中支持FP8格式。至於SambaNova、Cerebras和Groq等AI晶片製造商也將因為這一趨勢而受益。

換言之,FP8可讓AI產業有機會接受“AI-native”標準,以及跨系統的推理和訓練互操作性。在 IEEE正式製定標準之前,Graphcore將向業內其他人提供其規範。

總之,隨著深度學習應用程式複雜性的不斷增加,機器學習系統的可擴展性也變得不可或缺,大型分散式模型的訓練帶來了許多挑戰。在這種情況下,使用有效的FP8數位格式至關重要,因為在處理器之間交換資料時,它可以提高運算效率和通訊效率,進而提高功率效率。(826字)

參考資料:

Chip Makers Press For Standardized FP8 Format For AI. The Next Platform,2022/7/7

相關文章:

1. 台積電推出N4X製程 專攻高效能運算 預計2023年H1試產

2. 經濟部技術處引領記憶體技術研發,發展下世代AI晶片

3. AI晶片設計不再單純考慮性能 如何降低成本與提高效率將成為重點

4. 高效能 MCU是另一種金礦 從智慧工廠到智慧城市

5. 晶片短缺與AI崛起正改變晶片設計的新時代

6. 邊緣AI晶片正進入架構創新且應用增加之新趨勢

--------------------------------------------------------------------------------------------------------------------------------------------

【聲明】

1.科技產業資訊室刊載此文不代表同意其說法或描述,僅為提供更多訊息,也不構成任何投資建議。

2.著作權所有,非經本網站書面授權同意不得將本文以任何形式修改、複製、儲存、傳播或轉載,本中心保留一切法律追訴權利。

|