麻省理工、IBM合推計算機視覺新模型ObjectNet

科技產業資訊室 (iKnow) - May 發表於 2019年12月13日

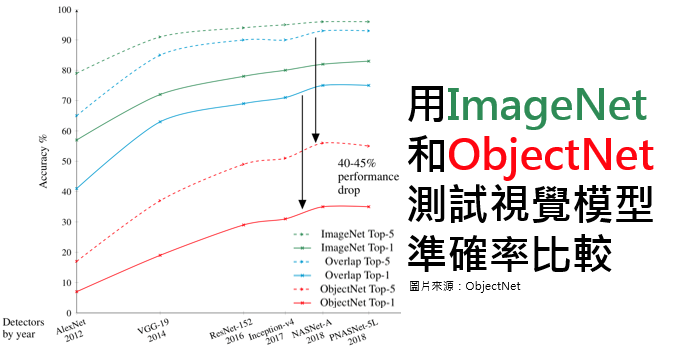

圖、用ObjectNet與ImageNet測試視覺模型準確率比較

近日,麻省理工學院和IBM 研究人員組成的團隊,共同創建了一個ObjectNet圖像識別數據集,這是一類高性能的視覺模型,同時難倒了目前世界上最好的計算機視覺模型。

目前,全球最大的「CV 習題庫」ImageNet,由世界上頂尖的計算機視覺專家李飛飛參與建立,應用於人工智慧領域中的圖像分類最常用來訓練和測試的數據集。最近,對該計算機視覺模型測試,結果發現:在 ImageNet 測試準確率高達 97% 的計算機視覺模型,在 ObjectNet 數據集上檢測的準確率下降到了 50%-55%。為何測試結果會如此差距?主要原因在於,目前幾乎所有的視覺模型,在類似於物體旋轉、背景變換、視角切換等複雜情境下,識別過程都缺乏穩定性。換句話說,並不是因為數據量不夠,而是模型對類似於旋轉、背景變換、視角切換等等的認知缺乏穩定性。

麻省理工學院計算機科學與人工智慧實驗室 (CSAIL) 和大腦、心智與機器中心 (CBMM) 的研究科學家 Andrei Barbu,是ObjectNet該項目的主持人之一。他在接受 DeepTech 專訪時表示以下見解,摘要如下:

AI人工智慧藉由神經元層組成的神經網絡在大量的原始數據中尋找規律,例如:透過機器學習上千張椅子的照片之後,而學會了椅子的形狀。於是,ImageNet 從Flickr等其他社交媒體網站上下載了接近 10 億張圖片,含有近 1500 萬張照片的資料庫,涵蓋了22000種物品。

計算機視覺模型已經學會了精確地識別照片中的物體,以至於有些模型在某些數據集上表現得比人類還要好。但是,當這些模型真正進入到生活中時,它們的準確率會顯著下降,這帶給自動駕駛汽車和其他使用計算機視覺的關鍵系統帶來了安全隱憂。

ObjectNet與ImageNet隨意收集的照片不同。因為,ObjectNet從多個視點在不同的背景上進行映像,提供的照片是有特殊背景和角度的,因而產生數據集的大量變化。研究人員讓自由職業者為數百個隨機擺放的家具物品拍照,告訴他們從什麼角度拍攝以及是擺在廚房、浴室還是客廳。因此,大多數檢測器對 ObjectNet中包含的大多數圖像都識別失敗了

麻省理工學院研究科學家認為,物體識別問題仍然是個難題,我們需要更好、更聰明的算法。機器仍然很難理解物體是三維空間存在,物體也可以旋轉和移動到新的環境中,目前這些概念並沒有構建到檢測器的架構中。

ObjectNet與Imagenet的區別為何?

Andrei Barbu認為:

1、收集圖像的方式可以控制偏差。我們告訴人們如何旋轉物體,在什麼背景中放置物體,以及在哪個角度拍照。在大多數的數據集中,圖像背景的信息會導致機器不自覺的「欺騙」,它們會憑藉對於廚房背景的了解來預測某個東西可能是平底鍋。

2、這些照片不是從社交媒體上收集的,所以它們不是那種好看的照片,人們也不想分享。我們還確保收集來自印度、美國以及不同社會經濟階層的圖像。我們還有損壞或破碎物體的圖像。

3、沒有訓練集。

一般會有訓練集及測試集,但ObjectNet沒有訓練集。

從新的角度想像物體的三維形狀,這也是計算機視覺的未來。ObjectNet的設計就是提供了一個更可靠的工具,用來檢測你的模型是不是足夠強。下一個版本的 ObjectNet開發,它對於檢測器來說會更加困難,因帶有部分遮擋的物體對象被其他物件部分覆蓋,因而造成探測器對有遮擋的物體的識別還不夠穩定。ObjectNet的目標是激勵研究人員開發出下一波革命性的技術。(1180字;圖1)

參考資料:

麻省理工、IBM合推新型數據集,「為計算機視覺黃金時代做準備」。DeepTech深科技,2019/12/12。

相關文章:

1.臉部辨識技術正進入社會各角落,其立法與使用方式將扮演普及關鍵

2.臉部辨識正進入汽車領域,協助理解駕駛情感與心理狀態

3.用AI解析腦部視覺神經元的偏好

4.索尼的ToF 3D感測器強化臉部辨識於手機應用

--------------------------------------------------------------------------------------------------------------------------------------------

【聲明】

1.科技產業資訊室刊載此文不代表同意其說法或描述,僅為提供更多訊息,也不構成任何投資建議。

2.著作權所有,非經本網站書面授權同意不得將本文以任何形式修改、複製、儲存、傳播或轉載,本中心保留一切法律追訴權利。

|